Googlebot

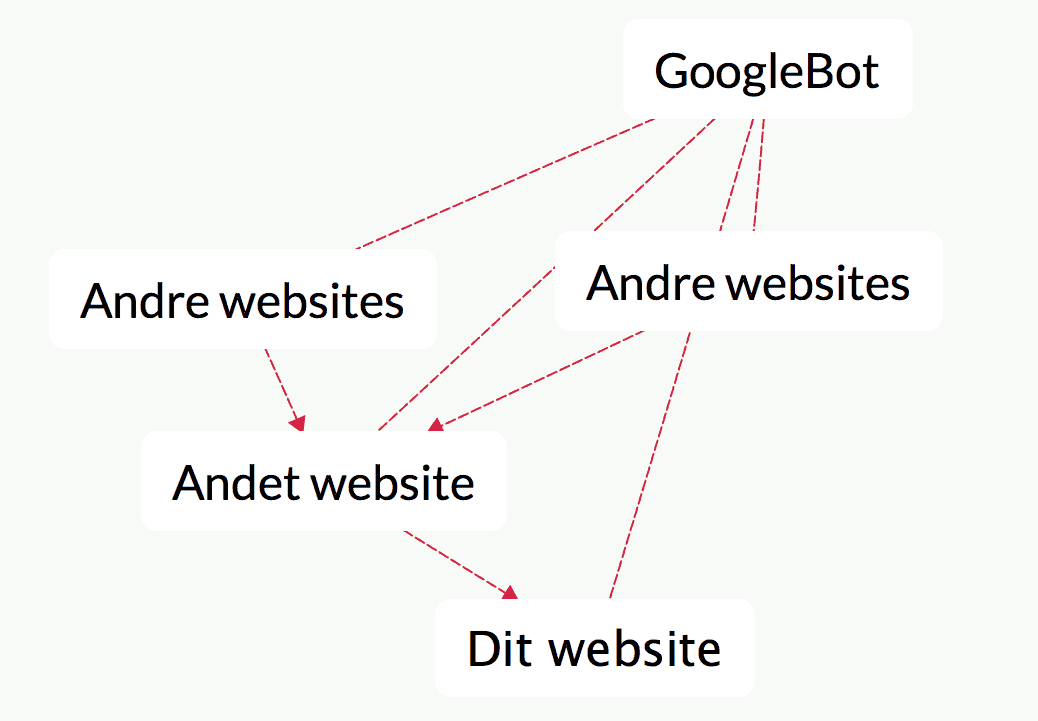

Googlebot er en lille bot, der crawler internettet. Googlebot følger links på hjemmesider og finder derigennem frem til nye sider og hjemmesider på internettet, der kan crawles og indekseres. Googlebot er også den bot, der finder nyt og opdateret indhold og foreslår, hvad der skal inkluderes i Googles store indeks. Googles indeks er det, du som bruger af Google søger i, når du skal finde informationer på internettet. Google bruger enorme ressourcer på at sende deres botter rundt omkring i alle nettets afkroge for at søge, identificere og indeksere. Googlebot er Googles webcrawler eller robot, om man vil.

Hvordan virker Googlebot?

Som tidligere nævnt følger Googlebot alle links, den falder over, når den besøger en hjemmeside. Herigennem finder den vej til nye sider og får genopfrisket, hvad der er på sider, som den måske allerede har besøgt før. Det er sådan, at Google opfanger, når en sides indhold har ændret sig, og dette er en nødvendig proces for altid at have en opdateret database, hvor brugere kan finde det nyeste indhold.

Googlebot bruger også sitemaps til at identificere sider, den skal besøge. Sitemaps er noget, mange webmastere gør brug af, men de er ikke nødvendige for, at Googlebot kan finde og indeksere sider. Dog kan de være en stor hjælp for Googlebot, og derfor anbefales det generelt altid, særligt på større websites, at gøre brug af sitemaps i XML-format, der automatisk opdateres (dynamisk).

Googlebot bruger også sitemaps til at identificere sider, den skal besøge. Sitemaps er noget, mange webmastere gør brug af, men de er ikke nødvendige for, at Googlebot kan finde og indeksere sider. Dog kan de være en stor hjælp for Googlebot, og derfor anbefales det generelt altid, særligt på større websites, at gøre brug af sitemaps i XML-format, der automatisk opdateres (dynamisk).

Googlebot besøger ikke hvert link, den falder over, med det samme. Alle links, Googlebot ikke tidligere har set, bliver lagt i en liste over sider, som Googlebot på et senere tidspunkt skal kigge nærmere på og vurdere, hvorvidt disse skal inkluderes i deres indeks.

Googlebot tjekker, som sagt, også løbende sider, den allerede har besøgt før. Dette gøres for at verificere, at adressen stadig fungerer, og at indholdet stadig er tilgængeligt. Google ønsker ikke at linke til sider, der ikke længere eksisterer, da det skaber en dårlig brugeroplevelse for deres brugere. Netop derfor er Google meget opmærksom på at gencrawle sider så ofte som muligt, særligt sider, de har vurderet, ofte ændrer deres indhold.

Googlebot bruger den dag i dag også kunstig intelligens til at sortere og indeksere hjemmesider. Googles kunstige intelligens hedder RankBrain, den kan du læse meget mere om i følgende artikel.

Hvor ofte besøger Googlebot din hjemmeside?

Hvis du vil finde ud af, hvor ofte Googlebot besøger din hjemmeside, findes der en lang række metoder til netop dette. En af de mest enkle metoder er at besøge Googles Search Console og gå til crawl-sektionen. Herunder kan du finde detaljeret statistik over, hvor ofte Googlebot besøger dine sider, samt hvilke sider de har kigget på og hvornår. Her finder du også oplysninger om indekseringstilstand.

Du kan også kigge i din serverlog og se efter Googlebots user-agent. Det kan være svært at genkende Googlebot på IP-adressen, da denne er dynamisk og derfor ofte skifter. Men ved at køre en reverse lookup kan du se, om user-agenten svarer korrekt. Du skal dog være opmærksom på, at det er nemt at udgive sig for at være Googlebot.

De forskellige Googlebotter

Googlebot findes i mange variationer og findes sandsynligvis også i et meget, meget stort antal – husk på, at de crawler og kigger på alt, der er i Googles indeks, hele tiden.

- Googlebot Desktop (Desktop-versionen af Googlebot, crawler og indekserer sider)

- Googlebot mobile (Mobilversionen af Googlebot, det er denne bot der crawler stort set alle hjemmesider den dag i dag, efter Google gik over til Mobile First indeksering)

- Googlebot Video (Googles videobot)

- Googlebot News (Google News bot)

- Googlebot images (Googles billedsøgningsbot)

Ofte stillede spørgsmål: Googlebot

Hvad er Googlebot?

Googlebot er Googles web-crawler eller undersøgelses robot, læser, vurderer og indekserer indholdet på diverse hjemmesider. Googlebot findes i mange variationer, der hver især crawler og undersøger alt der findes i Googles indeks, hele tiden. Af forskellige Googlebotter kan nævnes, Googlebot Desktop, googlebot Mobile, Googlebot Video, Googlebot News og Googlebot images.

Hvordan virker Googlebot?

Googlebot følger og identificerer alle links, som den støder på, når den besøger/crawler en hjemmeside. Formålet med Googlebotterne er at identificere, indeksere og vurdere indholdet på hjemmesider, således at Googles database altid er opdateret med det nyeste indhold og opdateret i forhold til ændringer på de enkelte webadresser.

Hvor ofte besøger Googlebot min hjemmeside?

Hvis du gerne vil vide, hvor ofte Googlebot besøger/crawler din hjemmeside, kan du b.la benytte dig af Google Search Console. Via crawl-sektionen, kan du finde statistik over hvor ofte og hvornår Googlebot besøger dine sider, samt finde oplysninger om indekseringstilstanden.